Un proyecto de investigación de Inteligencia Artificial (IA) dirigido por Facebook, podría ayudar a mejorar la comprensión del mundo desde una perspectiva en primera persona

Un proyecto de investigación de Inteligencia Artificial (IA) a largo plazo dirigido por Facebook podría ayudar a responder la eterna pregunta:

"¿Dónde puse esa cosa?"

El proyecto Ego4D tiene como objetivo mejorar la comprensión del mundo por parte de la IA desde una perspectiva "egocéntrica" en primera persona.

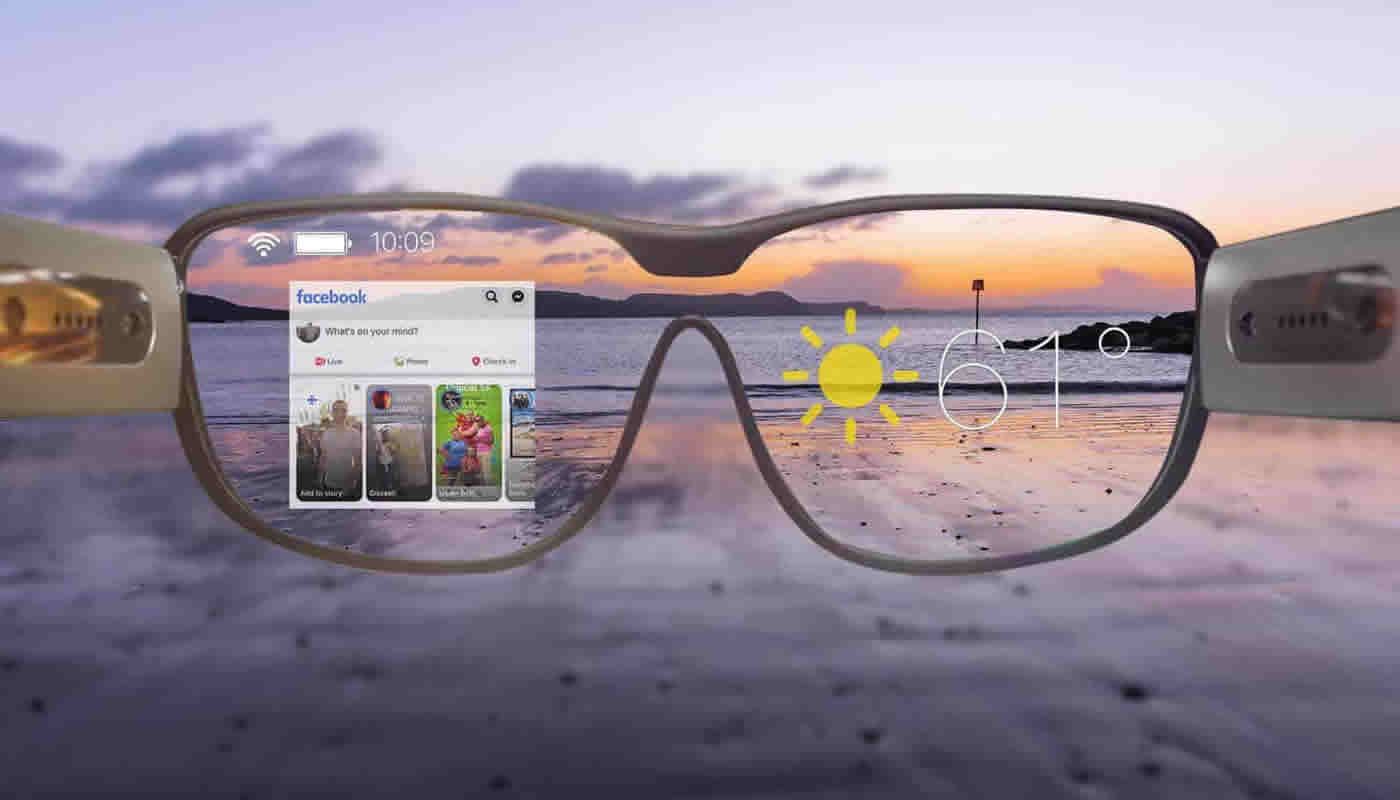

La esperanza es mejorar la utilidad de dispositivos como las gafas de realidad aumentada (AR).

Por ejemplo, podría permitirles ayudar con tareas como recordar dónde colocó las llaves.

En una publicación de blog, Facebook argumenta que

"La IA de próxima generación deberá aprender de los videos que muestran al mundo desde el centro de la acción".

La IA que entiende el mundo desde esta "perspectiva egocéntrica" podría ayudar a que los "dispositivos inmersivos" como las gafas AR y los cascos de realidad virtual (VR) sean tan útiles como los teléfonos inteligentes.

Facebook ha tenido un interés de larga data en la realidad virtual a través de su propiedad del fabricante de auriculares Oculus.

Ego4D es un esfuerzo colaborativo para recopilar un "conjunto de datos de video egocéntrico a gran escala" para ayudar en el desarrollo de sistemas de inteligencia artificial y visión por computadora que ayuden a los usuarios a interactuar con el mundo desde una perspectiva en primera persona.

El proyecto reúne a un consorcio de 13 universidades y laboratorios de nueve países.

El conjunto de datos, dijeron los investigadores, incluye "3.025 horas de videos de actividades de la vida diaria que abarcan cientos de escenarios (hogar, exteriores, lugar de trabajo, ocio, etc.) capturados por 855 usuarios únicos de cámaras".

Actualmente, los algoritmos de visión por computadora se entrenan utilizando grandes conjuntos de datos de imágenes y videos capturados en una perspectiva de tercera persona.

"Los sistemas de inteligencia artificial de próxima generación necesitarán aprender de un tipo de datos completamente diferente: videos que muestren el mundo desde el centro de la acción, en lugar de al margen",

Los conjuntos de datos, que según Facebook son "20 veces mayores que cualquier otro en términos de horas de metraje", estarán disponibles para los investigadores que firmen un acuerdo de uso de datos a partir de noviembre.

La compañía también desarrolló cinco "desafíos de referencia" para desarrollar asistentes de inteligencia artificial más útiles. Estos son, dijo Facebook:

- ¿Que paso cuando? (por ejemplo: "¿Dónde dejé mis llaves?")

- ¿Qué es probable que haga a continuación? (por ejemplo: "Espera, ya le agregaste sal a esta receta")

- ¿Qué estoy haciendo? (por ejemplo: "Enséñame a tocar la batería")

- ¿Quién dijo qué y cuándo? (por ejemplo: "¿Cuál fue el tema principal durante la clase?")

- ¿Quién interactúa con quién? (por ejemplo: "Ayúdame a escuchar mejor a la persona que me habla en este restaurante ruidoso")

Pero Facebook ha tenido una relación a veces tensa con los investigadores.

La idea de que una empresa que ha sido fuertemente criticada y multada por su historial de privacidad desee desarrollar tecnología con una visión tan íntima de nuestras vidas en "primera persona" también preocupará a algunos.

Sus nuevas gafas con cámara Ray-Ban Stories provocaron preguntas sobre privacidad, a pesar de la tecnología mucho más limitada.

Qué es un VPN y cuáles son los mejores servicios de red

El propósito principal de un VPN es proteger la privacidad y la seguridad del usuario en línea al crear una conexión cifrada entre el dispositivo del usuario y el servidor del proveedor de VPN