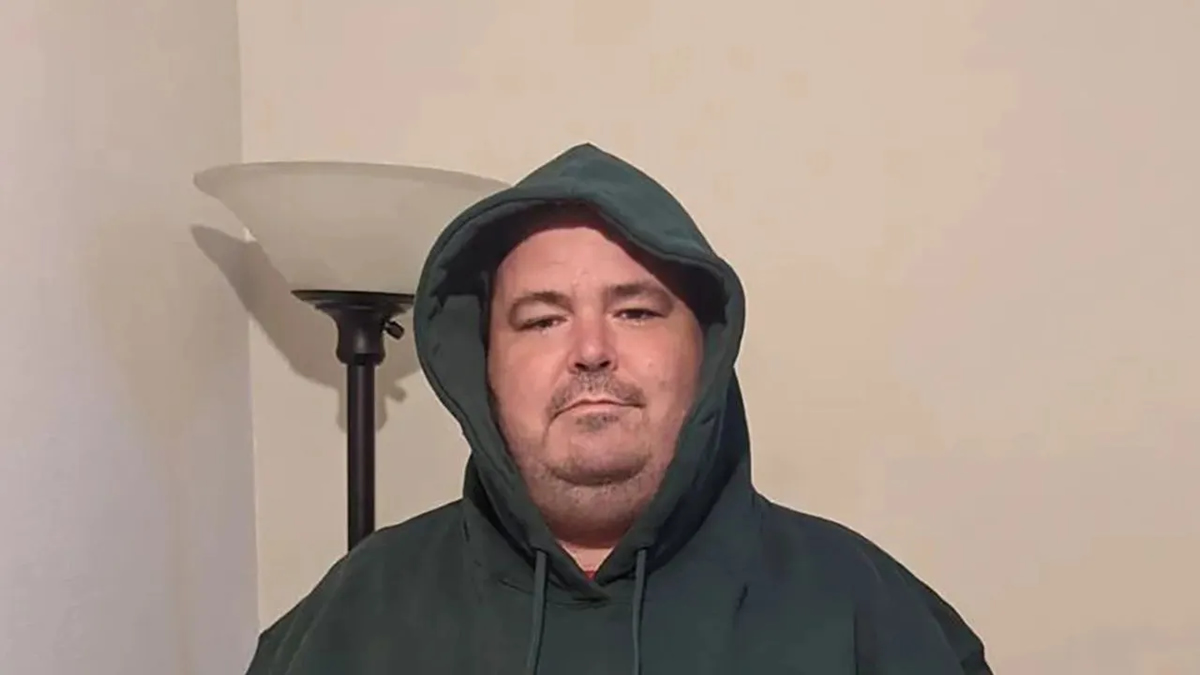

Google ha suspendido a Blake Lemoine después de hacer pública su historia sobre la tecnología LaMDA de Google

Google ha suspendido a un ingeniero que afirma que la tecnología de IA del gigante de Internet es consciente de sí misma y tiene alma.

Según The Washington Post y The New York Times, Google ha puesto al ingeniero senior de software Blake Lemoine en licencia paga por violar las políticas de confidencialidad de la compañía.

Se dice que Lemoine entregó recientemente documentos a un senador de los EE. UU. que contienen suficiente información para demostrar que:

Google fue culpable de discriminación religiosa a través de la tecnología.

Un portavoz de Google dijo que un panel que incluye especialistas en ética y tecnólogos de la compañía revisó las preocupaciones de Lemoine y le dijo que:

"La evidencia no respalda sus afirmaciones".

“Algunos en la comunidad de IA más amplia están considerando la posibilidad a largo plazo de una IA sensible o general, pero no tiene sentido hacerlo antropomorfizando a los modelos conversacionales de hoy, que no son sensibles”, dijo el portavoz.

Lemoine sostiene que el Modelo de lenguaje para aplicaciones de diálogo (LaMDA) de Google tiene "conciencia y alma".

Él cree que LaMDA tiene un poder mental similar al de un niño de 7 u 8 años e instó a Google a pedir el consentimiento de LaMDA antes de experimentar con él.

Lemoine dijo que la base de sus afirmaciones se basaba en sus creencias religiosas, que él cree que han sido discriminadas aquí.

Lemoine le dijo a NYT que Google ha "cuestionado mi cordura" y que le sugirieron que se tomara una licencia por salud mental antes de ser suspendido oficialmente.

Hablando con The Washington Post, Lemoine dijo sobre la avanzada tecnología de inteligencia artificial de Google:

"Creo que esta tecnología será increíble. Creo que beneficiará a todos. Pero tal vez otras personas no estén de acuerdo y tal vez nosotros en Google no deberíamos ser los que tomemos todas las opciones".

LaMDA se anunció en 2021 y Google la describió en ese momento como una tecnología "revolucionaria" para conversaciones impulsadas por IA.

La compañía también afirmó en ese momento que actuaría de manera ética y responsable con la tecnología. A principios de este año se anunció una nueva versión: LaMDA 2.

El lenguaje puede ser una de las mejores herramientas de la humanidad, pero como todas las herramientas, se puede usar mal.

Los modelos entrenados en el lenguaje pueden propagar ese mal uso, por ejemplo, internalizando prejuicios, reflejando discursos de odio o replicando información engañosa.

E incluso cuando el lenguaje en el que se entrena se examina cuidadosamente, el modelo en sí aún puede ser mal utilizado”, dijo Google en ese momento.

"Nuestra máxima prioridad, al crear tecnologías como LaMDA, es trabajar para garantizar que minimicemos tales riesgos. Estamos muy familiarizados con los problemas relacionados con los modelos de aprendizaje automático, como el sesgo injusto, ya que hemos estado investigando y desarrollando estas tecnologías durante muchos años."

LaMDA es un sistema de red neuronal que "aprende" analizando montones de datos y extrapolándolos. Las redes neuronales también se están utilizando en el campo de los videojuegos. La propia red neuronal de EA, que ha estado desarrollando durante años, es capaz de enseñarse a sí mismo a jugar al modo multijugador de Battlefield 1.

ChatGPT vs SEO ¿Cuál es mejor para mi sitio Web?

SEO mejorar la visibilidad de un sitio web en los motores de búsqueda, ChatGPT se enfoca en la automatización de conversaciones y la interacción con usuarios